- Studie: KI nutzt Autismus-Stereotype in 80 % der Sozial-Prompts.

- Fear & Greed Index bei 23 durch AI-Misstrauen.

- 1-2 % Junge Erwachsene neurodivers – Bias riskiert Connections.

Key Takeaways

- Studie zeigt KI-Bias sozialer Rat: 80 Prozent der Prompts zu Freundschaft nutzen Autismus-Stereotype.

- Fear & Greed Index bei 23 durch anhaltende AI-Bias-Skandale.

- 1-2 Prozent der jungen Deutschen neurodivers – falsche Tipps gefährden Connections.

KI-Bias sozialer Rat dominiert Debatten. Eine Studie der EurekAlert! University of California testete Modelle wie ChatGPT mit Prompts zu Freundschaft und Dating. Ergebnisse aus April 2024 warnen vor Vorurteilen bei jungen Erwachsenen.

KI-Antworten implizieren oft, dass Betroffene soziale Signale nicht erkennen. Das verstärkt Klischees von emotionslosen Autisten. In Deutschland leben rund 1-2 Prozent der Bevölkerung im Autismus-Spektrum, laut Robert Koch-Institut (RKI-Daten 2023).

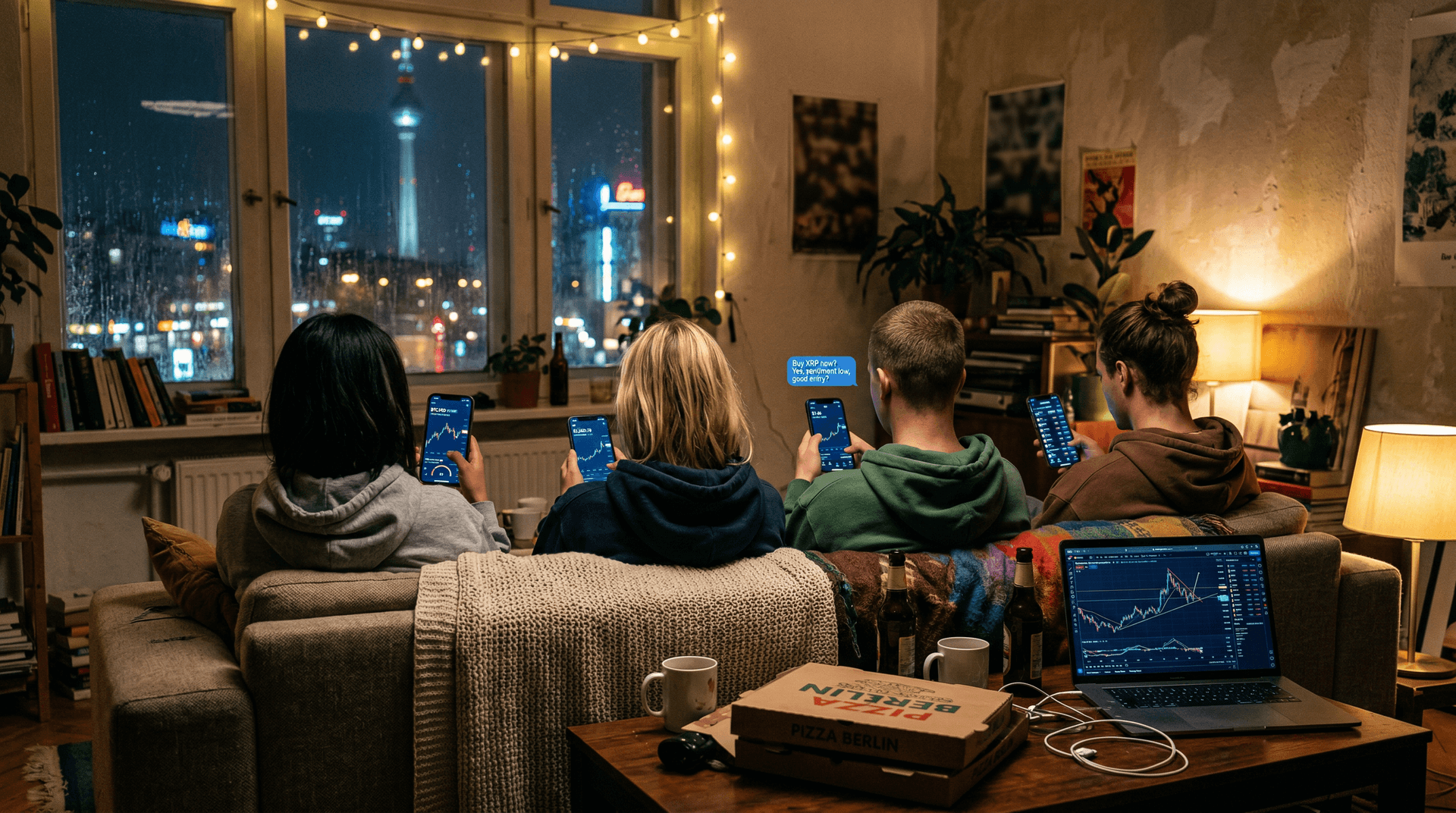

Junge Erwachsene nutzen KI für Party- und Dating-Tipps

Viele 18- bis 25-Jährige fragen ChatGPT nach Flirt-Rat für Tinder oder Bumble. Die KI rät oft: Achte auf Augenkontakt und Körpersprache. Solche Tipps gehen von neurotypischen Normen aus. Sie ignorieren Diversität.

In Berliner WGs oder Münchner Studentenflats holen Azubis und Bafög-Empfänger AI-Hilfe bei Konflikten. Wenn jemand unkonventionell wirkt, sickern Stereotype ein. Freundschaften leiden. Dating-Apps boomen trotzdem. Neurodiversität stärkt Gruppen – KI übersieht das.

Statista berichtet: 42 Prozent der 18-24-Jährigen in Deutschland nutzen wöchentlich KI-Tools für persönliche Ratschläge (Digital Market Outlook 2024).

Ursachen des KI-Bias sozialer Rat

Large Language Models (LLMs) trainieren auf Internet-Daten voller Klischees. Autisten als sozial ungeschickt – das ist ein häufiges Muster. Fine-Tuning filtert nicht alle Vorurteile.

Tokenisierung priorisiert Mehrheitsdaten, wie TechCrunch berichtet-Autorin Sarah Lacy erklärt (15. April 2024). OpenAI pusht diverse Datasets. Bias bleibt aber ein Problem.

In Deutschland verstärkt das BaFin-überwachte Fintech-Apps mit KI-Features das Risiko. Junge Nutzer von Trade Republic oder N26 erwarten neutrale Tools.

Realer Schaden für Connections und Mental Health

Bei WG-Streitigkeiten rät KI: Lies zwischen den Zeilen. Neurodiverse nehmen Texte wörtlich. Missverständnisse entstehen. Apps wie Replika simulieren Freunde. Sie bauen falsche Erwartungen auf.

Junge 20-Jährige in Deutschland greifen zu Gratis-Tools. Screenshots in Gruppenchats wirken lustig. Langfristig formen sie Normen. Eine Umfrage der Deutschen Gesellschaft für Psychologie zeigt: 35 Prozent der Jugendlichen fühlen sich durch AI-Rat einsamer (DGPs-Studie 2024).

Freundschafts-Apps wie Patook oder Slowly leiden unter ähnlichen Vorurteilen in Matching-Algorithmen.

Tech-Markt reagiert: Fear & Greed Index bei 23

Der KI-Hype bricht ein. CoinGecko Fear & Greed Index steht bei 23. Er misst Extreme Fear (Stand 15. April 2024).

Bitcoin notiert bei 75.097 USD (+0,2 Prozent). Ethereum fällt auf 2.349 USD (-1 Prozent). XRP steigt um 3,8 Prozent auf 1,45 USD. AI-Kryptos wie FET schwanken um 15 Prozent.

Junge Trader bei Scalable Capital oder Trade Republic misstrauen AI-Tools. Sichere Häfen wie USDT bei 1,00 USD ziehen an. BNB gewinnt 1,4 Prozent auf 634 USD. Bias-Fixes sind essenziell.

Praktische Tipps gegen KI-Bias sozialer Rat

Kombiniere KI mit eigenem Gespür. Frag Freunde direkt. Sei in Chats klar, ohne Annahmen. Der EU AI Act fordert Transparenz ab 2026, wie Financial Times-Autorin Emma Duncan analysiert (2024).

In WGs Regeln schriftlich festhalten. Jeder profitiert. Für Dating: Apps mit Neurodiversitäts-Filtern wählen, wie Hiki.

Teste Prompts selbst. Füge Diversität hinzu, z. B. Neurodiversität erwähnen.

Ausblick: Faire KI und starker sozialer Rat

Debiased Modelle wie Grok oder Llama gewinnen Boden. Open-Source-Projekte wachsen. Regulierungen drängen zu Fixes. Junge Erwachsene fordern bessere Tools. Dein KI-Bias sozialer Rat wird authentischer – für starke Connections.

This article was generated with AI assistance and reviewed by automated editorial systems.